カオナビHRテクノロジー総研調査レポートREPORT

AI時代のHRテック ~グローバルHRテック企業のガバナンス体制とは~

AI対応に積極的なWorkday

欧州AI規制法に見られる様に、新しいAI規制ルールの波が起こりつつあります。そのような中で、グローバルなHRテックベンダーのWorkdayは、以前からAIの活用に積極的な企業であるだけでなく、EUのAI事務局とも情報交換などしつつ、AI活用のガバナンス体制についても積極的に構築を進めています。具体的には、自社では独自のAI倫理指針をかかげ、その理念を実践するための「RAI(責任あるAI)ガバナンスプログラム」への取り組みを行っています。

本稿では今後のHRテック企業のAIガバナンスの在り方の例として、Workdayの取り組みについて見ていきます。

なお本稿においては、日本の読者にも分かりやすいように、例示を中心にかなり意訳した表現に変更をしています。厳密な内容に興味がある場合はWorkdayの公式資料などをご覧ください。

WorkdayのAI倫理方針

Workdayでは、以下のようなAIについての倫理的方針を規定し、社内外に発信しています。

- 人間の可能性を拡げる

- 社会にポジティブな影響を与える

- 透明性と公平性を重んじる

- プライバシーとデータ保護を実現する

RAIガバナンスプログラムの体制

Workdayは、AIガバナンスの責任者としてCRAIO( 最高AI責任者)のポストを設けています。CRAIOのリーダーシップのもと、後述する様々な組織が具体的なアクションを担っています。

RAIアドバイザリーボード:

RAIアドバイザリーボードは、エグゼクティブで構成されたAIに関する諮問委員会です。メンバーは、CCO(最高コンプライアンス責任者)、CDO(最高ダイバーシティ責任者)、CTO(最高技術責任者)、CPO(最高製品責任者)で、CLO(最高法務責任者)が議長を務めます。

定期的に開催され、RAIプログラムに助言・監督を行います。場合によっては、プロダクトのリリースを停止することもあるそうです。

RAI専門チーム:

AIに関わるリスクの特定および軽減について検討するチームです。先述のCRAIO(最高AI責任者)に加え社会科学者、データサイエンティスト、エンジニア、トレーニングの専門家、コミュニケーションの専門家などで構成されています。レポートラインは、最高法務責任者となっています。CTOやCPOの下に所属しないことで、事業サイドからの独立性を保っています。

プログラム設計と運営、トレーニング、開発、AI・機会学習技術などの倫理的レビューのとりまとめに責任を持ちます。また、RAIガバナンスのフレームワークの開発や、個別の案件を上述のボードに持ち込むことも行います。

RAIチャンピオン:

AIに関して意識の高い現場のエキスパートです。上述の専門チームに対し情報提供を行ったり討議に参加したりします。また、RAIチャンピオンは、プロダクト・技術チームなど企業の全体に配置され、AI活用の在り方について、従業員への理解浸透を担っています。

RAIガバナンスプログラムの実装 ―開発―

次に、責任あるAIを実際どのように業務で実現しているか、開発プロセスを例に見ていきます。

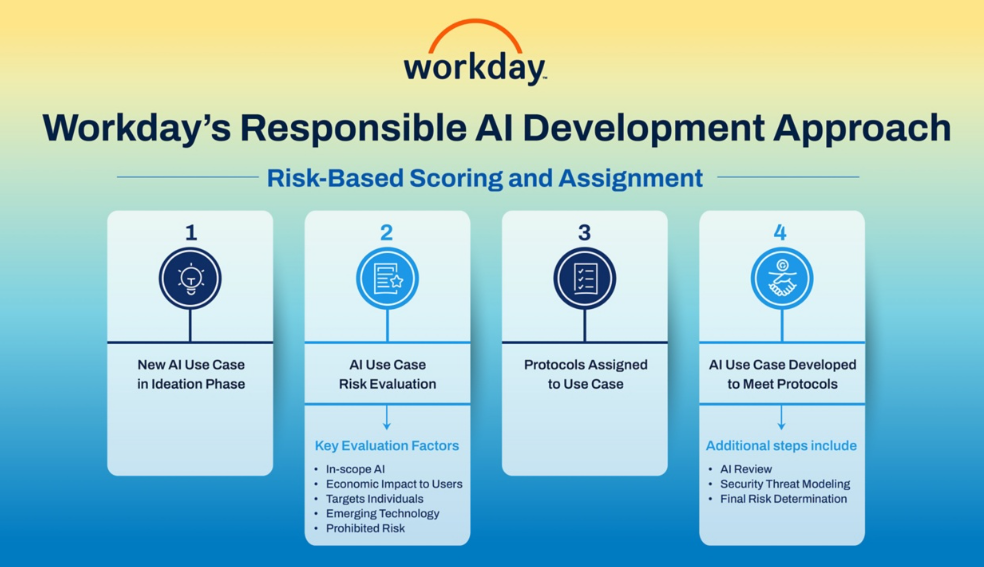

WorkdayはAIシステム開発の各段階において、下記の1、2の考慮事項を業務に組み込むことで、自社のAIシステム開発におけるガバナンスを実現しています。

1 リスク評価:

まず、新しいAIやMLプロジェクトは、構想段階でその特徴と用途に基づいて評価を受け、欧州AI規制法の定義に対応したリスクレベルが特定されます。リスクレベルの 具体的な評価ポイントとしては、使用技術、影響の大きさ、監視にあたる懸念などが含まれています。ここで許容できないリスクレベルと判定された事案は、開発が許可されません。具体的には、開発が許可されないリスクレベルの例として、「強制的に従業員を監視するAIシステム」を挙げることができます。こうしたシステムは欧州AI規制法においても人の基本的な権利に関わるもの、とされています。

2 ガイドラインの割り当て:

その後、AIに関する新プロジェクトには関連するリスクに対処するためのガイドラインが割り当てられます。開発チームはこのガイドラインに沿ってプロダクトを構築することで、責任あるAIの実装ができるようになっています。

例えば給与計算のミスを自動検知するAIシステムよりも、従業員の採用可否を判断する提案するAIシステムのほうがリスクが高いため、より厳しいガイドラインを必要とします。後者の方が影響が大きい(従業員のキャリアに大きな影響を与えうる)という考え方です。

ガイドラインは、透明性、公平性、説明可能性、設計哲学、データの質、堅牢性といった領域をカバーしています。

この一連のRAIガイドラインは、米国国立標準技術研究所のAIリスク管理フレームワーク(NISTのAI-RMF)に記載のベンチマークを活用して構築されました。このガイドラインの運用には、自社で構築した評価ツールを導入しています。プロダクトマネジャーが一連の質問に回答することで、想定される用途などに関連したRAIガイドラインを特定できるようになっています。

ーWorkdayサイトより、「責任あるAIの開発アプローチ」ー

RAIガバナンスプログラムの実装 ―顧客支援―

欧州AI規制法でも規定されているように、正しくAIを活用するためには、提供側の努力だけでなく、導入側が適切に使いこなす必要があります。そのため、AIを活用するHRシステムベンダーは、顧客との連携も欠かせません。Workdayは、AIシステムの使用方法とデータの管理方法について、顧客を支援するためのツールとリソースを提供しています。

提供ツール:

- 機能有効化: 顧客は自社で使用する機能、および使用しない機能を選別できる

- データ貢献制御: 顧客は、Workday MLモデル(機械学習モデル)を改善するために自社のデータを使用するかどうか、を制御できる

- 透明性: 顧客が、MLモデルの構築のための元データを確認できるようにする。そのために必要な情報を、ドキュメント、ツールなどの形で用意している

- 詳細なアクセス制御とセキュリティ: 顧客がAIガバナンスチーム、セキュリティ、プライバシー、法務、コンプライアンスなど、関連するステークホルダーを自由に選択・構成できるセキュリティグループ設定機能を提供。これらのグループは、ニーズに合わせてWorkday AIにおけるデータ使用に関する意思決定を行うことができる

提供リソース:

- AIファクトシート: AIの各機能がどのように開発、トレーニング、テストされ、モニタリングされたかを記述したもの。下記項目などの概要および、信頼性、精度、公平性などの分野における定期的なテスト結果サマリも含まれる。

-

Ø AI機能

Ø モデルのインプットとアウトプット

Ø モデルのトレーニング

Ø プライバシー配慮

今後のAIガバナンスへのアプローチ

ここまで、AIガバナンスについてWorkdayの取り組みを紹介しました。欧州AI規制法はシステムのカテゴリーや市場投入のタイミングによって、段階的な適用が定められており、具体的な類型や規定詳細が今後も随時発行されていく見込みです。日本のAI関連のガイドライン等も、法整備の進展が予定されています。加えて、今後の技術発展やAIシステムのさらなる普及に応じて、ルールが改定されていくことが想定されます。こういった動きに伴い、各社のガバナンスにも継続的なアップデートが求められます。

また、産官を問わずそれらを支援するための研究やコンソーシアムなどの活動も活発化していくことが予想されます。そのため、AIガバナンスの設計と運用においては、最初から完璧を期す必要は無く、まずは試行錯誤を念頭にスタートしつつ、適宜変化させていくことが一つの方向性だと思われます。

その際にWorkdayの取り組みは一つの参考になるでしょう。

Responsible AI Takes Two: Developers and Deployers Must Partner

- 本サイト記事の引用・転載の際は、必ず「出典:カオナビHRテクノロジー総研」と明記してください

- Webページなど電子的な媒体への引用・転載の場合、該当記事のURLも加えて掲載ください。

- 報道関係者様による引用・転載の場合、掲載動向の把握のため、こちらまでご連絡いただけますようお願い致します。

最近の投稿

- 2026年3月23日

- 2026年2月26日

- 2026年2月20日

- 2026年2月6日

- 2026年1月15日

カテゴリ別アーカイブ

年別アーカイブ

- 本サイト記事の引用・転載の際は、必ず「出典:カオナビHRテクノロジー総研」と明記してください

- Webページなど電子的な媒体への引用・転載の場合、該当記事のURLも加えて掲載ください。

- 報道関係者様による引用・転載の場合、掲載動向の把握のため、こちらまでご連絡いただけますようお願い致します。